- May -akda Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:54.

- Huling binago 2025-01-22 17:43.

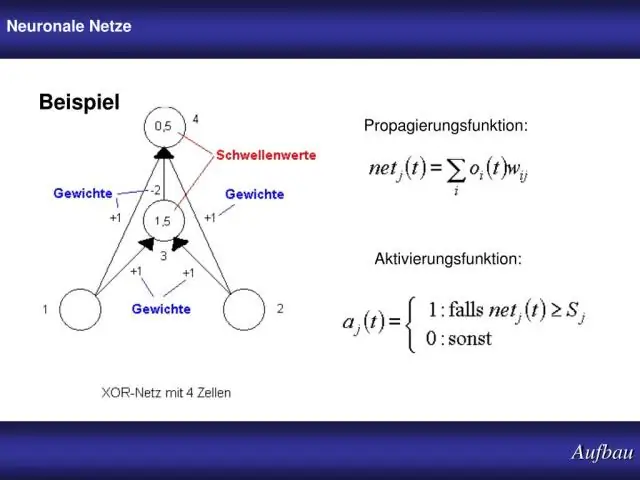

Mga function ng pag-activate ay mga mathematical equation na tumutukoy sa output ng a neural network . Ang function ay nakakabit sa bawat isa neuron nasa network , at tinutukoy kung dapat itong i-activate ("tanggalin") o hindi, batay sa kung ang bawat isa ng neuron may kaugnayan ang input para sa hula ng modelo.

Dahil dito, ano ang papel ng activation function sa neural network?

Kahulugan ng activation function :- Pag-andar ng pag-activate nagpapasya, kung a neuron dapat i-activate o hindi sa pamamagitan ng pagkalkula ng weighted sum at karagdagang pagdaragdag ng bias dito. Ang layunin ng activation function ay upang ipakilala ang non-linearity sa output ng a neuron.

Katulad nito, ano ang mga function ng activation at bakit kinakailangan ang mga ito? Mga function ng pag-activate ay talagang mahalaga para sa isang Artificial Neural Network na matuto at magkaroon ng kahulugan ng isang bagay na talagang kumplikado at Non-linear na kumplikadong functional mapping sa pagitan ng mga input at variable ng pagtugon. sila ipakilala ang mga hindi linear na katangian sa aming Network.

ano ang layunin ng activation function?

Ang layunin ng activation function ay upang magdagdag ng ilang uri ng hindi linear na ari-arian sa function , na isang neural network. Kung wala ang activation function , ang neural network ay makakagawa lamang ng mga linear na pagmamapa mula sa mga input x hanggang sa mga output na y.

Ano ang activation function sa deep learning?

Sa isang neural network , ang activation function ay responsable para sa pagbabago ng summed weighted input mula sa node patungo sa activation ng node o output para sa input na iyon. Sa tutorial na ito, matutuklasan mo ang rectified linear activation function para sa malalim na pag-aaral ng mga neural network.

Inirerekumendang:

Ano ang ginagawa ng paggawa ng isang function na static?

Sa C, ang isang static na function ay hindi nakikita sa labas ng unit ng pagsasalin nito, na kung saan ay ang object file kung saan ito pinagsama-sama. Sa madaling salita, ang paggawa ng isang function na static ay naglilimita sa saklaw nito. Maaari mong isipin ang isang static na function bilang 'pribado' sa * nito. c file (bagaman hindi ito mahigpit na tama)

Ano ang pagkakaiba sa pagitan ng virtual function at purong virtual function sa C++?

Ang pangunahing pagkakaiba sa pagitan ng 'virtual function' at 'pure virtual function' ay ang 'virtual function' ay may depinisyon nito sa base class at pati na rin ang inheriting derived classes ay muling tukuyin ito. Ang purong virtual na function ay walang kahulugan sa base class, at ang lahat ng nagmana na nagmula na mga klase ay kailangang muling tukuyin ito

Ano ang pagkakaiba sa pagitan ng virtual function at overriding ng function?

Ang mga virtual na function ay hindi maaaring maging static at hindi rin maaaring maging isang function ng kaibigan ng ibang klase. Ang mga ito ay palaging tinukoy sa base class at na-override sa nagmula na klase. Hindi ipinag-uutos para sa nagmula na klase na i-override (o muling tukuyin ang virtual function), kung gayon ang base class na bersyon ng function ay ginagamit

Ano ang multilayer neural network?

Ang multilayer perceptron (MLP) ay isang klase ng feedforward artificial neural network (ANN). Ang MLP ay binubuo ng hindi bababa sa tatlong layer ng mga node: isang input layer, isang hidden layer at isang output layer. Maliban sa mga input node, ang bawat node ay isang neuron na gumagamit ng nonlinear activation function

Ano ang Function Point ipaliwanag ang kahalagahan nito Ano ang function oriented metrics?

Ang Function Point (FP) ay isang yunit ng pagsukat upang ipahayag ang dami ng functionality ng negosyo, isang sistema ng impormasyon (bilang isang produkto) na ibinibigay sa isang user. Sinusukat ng mga FP ang laki ng software. Malawakang tinatanggap ang mga ito bilang isang pamantayan sa industriya para sa functional sizing