- May -akda Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:54.

- Huling binago 2025-01-22 17:43.

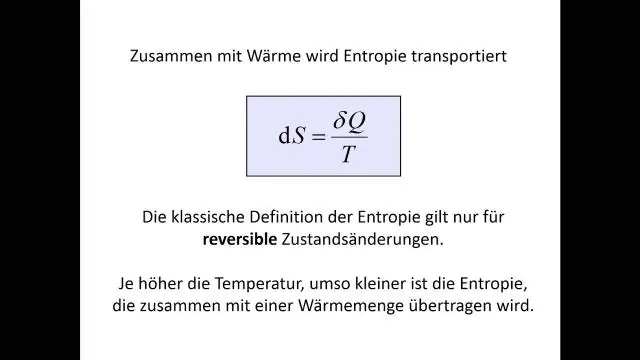

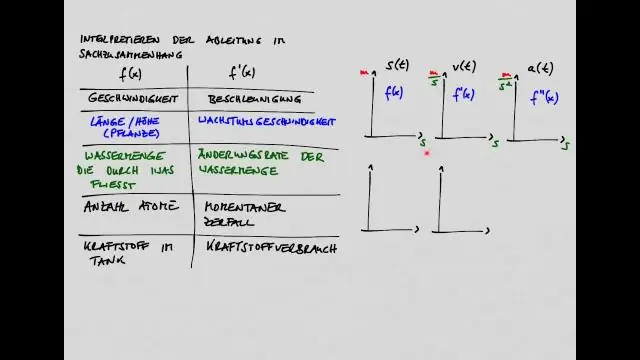

Entropy ay tinukoy bilang: Entropy ay ang kabuuan ng probabilidad ng bawat etiketa na natitiklop ang probabilidad ng log ng parehong label na iyon. Paano ako makakapag-apply entropy at maximum entropy sa mga tuntunin ng pagmimina ng teksto ?

Tanong din, ano ang entropy sa data mining?

Entropy . Ang isang puno ng desisyon ay binuo top-down mula sa isang root node at nagsasangkot ng paghati sa datos sa mga subset na naglalaman ng mga instance na may katulad na mga halaga (homogenous). Gumagamit ng ID3 algorithm entropy upang kalkulahin ang homogeneity ng isang sample.

Bukod pa rito, alin ang kahulugan ng entropy sa machine learning? Entropy , tulad ng nauugnay sa machine learning , ay isang sukatan ng randomness sa impormasyong pinoproseso. Mas mataas ang entropy , mas mahirap gumawa ng anumang konklusyon mula sa impormasyong iyon. Ang pag-flipping ng barya ay isang halimbawa ng isang aksyon na nagbibigay ng impormasyon na random. Ito ang kakanyahan ng entropy.

Nagtatanong din ang mga tao, alin ang kahulugan ng entropy sa decision tree?

Nasir Islam Sujan. Hun 29, 2018 · 5 minutong pagbabasa. Ayon sa Wikipedia, Entropy ay tumutukoy sa kaguluhan o kawalan ng katiyakan. Kahulugan : Entropy ay ang mga sukat ng karumihan, kaguluhan o kawalan ng katiyakan sa isang grupo ng mga halimbawa.

Paano mo kinakalkula ang entropy at makakuha?

Pagkamit ng Impormasyon ay kalkulado para sa split sa pamamagitan ng pagbabawas ng mga weighted entropies ng bawat sangay mula sa orihinal entropy . Kapag nagsasanay ng Decision Tree gamit ang mga sukatang ito, ang pinakamagandang hati ay pipiliin sa pamamagitan ng pag-maximize Pagkamit ng Impormasyon.

Inirerekumendang:

Alin ang kahulugan ng entropy sa decision tree?

Entropy: Ang isang puno ng desisyon ay binuo sa itaas-pababa mula sa isang root node at nagsasangkot ng paghahati ng data sa mga subset na naglalaman ng mga pagkakataon na may katulad na mga halaga (homogeneous). Gumagamit ang ID3 algorithm ng entropy upang kalkulahin ang homogeneity ng isang sample

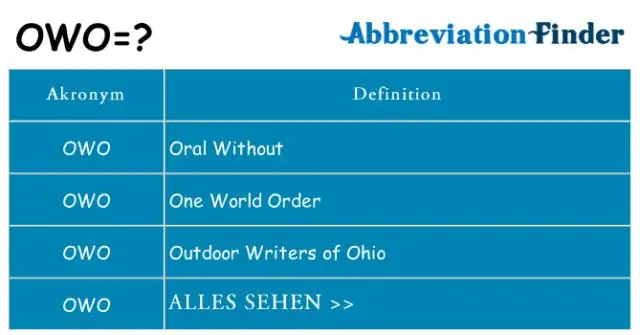

Ano ang ibig sabihin ng WR sa teksto?

The Meaning of WR WR means 'Warm Regards' Kaya ngayon alam mo na -WR means 'Warm Regards' - wag mo kaming pasalamatan.YW

Ano ang ibig sabihin ng KMT sa teksto?

Ang Kahulugan ng KMT Kaya ngayon alam mo na - ang ibig sabihin ng KMT ay 'Kiss My Teeth' -huwag kang magpasalamat sa amin. YW! Ano ang ibig sabihin ng KMT? Ang KMT ay isang acronym, abbreviation o slang na salita na ipinaliwanag sa itaas kung saan ibinigay ang KMTdefinition

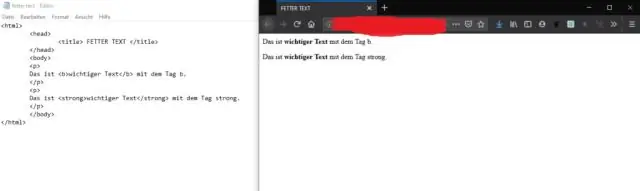

Ano ang default na laki ng teksto sa HTML?

Ang default na laki ng isang font ay 3

Ano ang entropy information gain?

Information Gain = kung gaano karaming Entropy ang inalis namin, kaya ito ay may katuturan: mas mataas na Information Gain = mas maraming Entropy ang inalis, na kung ano ang gusto namin. Sa perpektong kaso, ang bawat sangay ay maglalaman lamang ng isang kulay pagkatapos ng hati, na magiging zero entropy