- May -akda Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:54.

- Huling binago 2025-01-22 17:44.

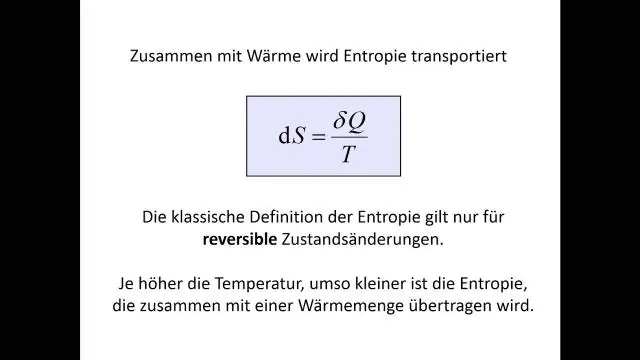

Pagkamit ng Impormasyon = magkano Entropy tinanggal namin, kaya

Makatuwiran ito: mas mataas Pagkamit ng Impormasyon = higit pa Entropy tinanggal, na kung ano ang gusto namin. Sa perpektong kaso, ang bawat sangay ay maglalaman lamang ng isang kulay pagkatapos ng hati, na magiging zero entropy !

Bukod, ano ang nakuha ng impormasyon at entropy sa puno ng desisyon?

Pagkamit ng Impormasyon : Ang pagkuha ng impormasyon ay batay sa pagbaba sa entropy pagkatapos na hatiin ang isang set ng data sa isang katangian. Pagbuo ng a puno ng desisyon ay tungkol sa paghahanap ng katangian na nagbabalik ng pinakamataas pagkuha ng impormasyon (ibig sabihin, ang pinaka homogenous na mga sanga). Hakbang 1: Kalkulahin entropy ng target.

Katulad nito, ano ang entropy sa data? Impormasyon entropy ay ang average na rate kung saan ang impormasyon ay ginawa ng isang stochastic source ng datos . Ang sukatan ng impormasyon entropy nauugnay sa bawat posible datos ang value ay ang negatibong logarithm ng probability mass function para sa value: kung saan ang inaasahan ay tinukoy ng probability.

Kaugnay nito, ano ang ibig sabihin ng pagkakaroon ng impormasyon?

Pagkamit ng impormasyon kinakalkula ang pagbawas sa entropy o sorpresa mula sa pagbabago ng isang dataset sa ilang paraan. Pagkamit ng impormasyon ay ang pagbawas sa entropy o sorpresa sa pamamagitan ng pagbabago ng isang dataset at kadalasang ginagamit sa mga puno ng desisyon sa pagsasanay.

Alin ang kahulugan ng entropy sa decision tree?

Kahulugan : Entropy ay ang mga sukat ng karumihan, kaguluhan o kawalan ng katiyakan sa isang grupo ng mga halimbawa.

Inirerekumendang:

Ano ang Media at Information Literacy Grade 11?

People Media (Media and Information Literacy for Grade 11) 1. Print Media -Midyum na gumagamit ng anumang nakalimbag na materyales (dyaryo, magasin, atbp.) upang maghatid ng impormasyon. Mayroon itong katamtamang hanay ng madla at gumagamit ng visual na teksto o mga larawan. -Nananatili bilang pangunahing tulong/kasangkapan ng mga guro at mag-aaral sa pag-aaral sa silid-aralan (mga aklat)

Ano ang papel ng computer information technology?

Ang computer information technology (CIT) ay ang paggamit at pag-aaral ng mga computer, network, computer language, at database sa loob ng isang organisasyon upang malutas ang mga tunay na problema. Inihahanda ng major ang mga mag-aaral para sa application programming, networking, system administration, at internet development

Alin ang kahulugan ng entropy sa decision tree?

Entropy: Ang isang puno ng desisyon ay binuo sa itaas-pababa mula sa isang root node at nagsasangkot ng paghahati ng data sa mga subset na naglalaman ng mga pagkakataon na may katulad na mga halaga (homogeneous). Gumagamit ang ID3 algorithm ng entropy upang kalkulahin ang homogeneity ng isang sample

Ano ang mga antas ng classified information?

Ang Estados Unidos ay may tatlong antas ng pag-uuri: Kumpidensyal, Lihim, at Nangungunang Lihim

Ano ang entropy sa pagmimina ng teksto?

Ang entropy ay tinukoy bilang: Ang entropy ay ang kabuuan ng probabilidad ng bawat etiketa na natitiklop ang probabilidad ng log ng parehong label na iyon. Paano ko mailalapat ang entropy at maximum na entropy sa mga tuntunin ng pagmimina ng teksto?